ErgoHCI Intelligent Equipment Multi-Channel-Mensch-Computer-Interaktion-Testlabor ist Beijing Zunda Technologie Co., Ltd. im Kontext der schnellen Entwicklung und Anwendung von Technologien wie Künstlicher Intelligenz, Big Data, Emotional Computing, Multi-Channel-Mensch-Computer-Interaktion, kombiniert mit Forschungsmethoden in Disziplinen und Bereichen wie Menschenverfahren, Benutzererfahrung, Psychologie, kognitive Neurowissenschaften, autonome Innovation und Konfiguration von Mensch-Computer-Interaktion-Testlabor.

1. Einleitung zum Labor

ErgoHCI Smart Equipment Multi-Channel-Mensch-Computer-Interaktion-TestlaborBeijing Zunda Technologie Co., Ltd. ist im Kontext der schnellen Entwicklung und Anwendung von Technologien wie Künstlicher Intelligenz, Big Data, Emotional Computing, Mehrkanal-Mensch-Computer-Interaktion, kombiniert mit Forschungsmethoden in Disziplinen und Bereichen wie Human-Cause-Engineering, Benutzererfahrung, Psychologie, Kognitive Neurowissenschaften, unabhängige Innovation und Konfiguration von Mensch-Computer-Interaktion-Testlabor, in der Lage, in verschiedenen Umgebungen wie Labor, virtuelle Realität, Fahrsimulation, reale Realisierung Feld, basierend auf Produktprototypen, um Mehrkanal-Mensch-Computer-Interaktion-Tests durchzuführen. Das Labor kombiniert prototypbasiertes Experimentdesign, mehrkanale intelligente Mensch-Computer-Interaktion, ErgoLAB-multimodale Datensynchronisierung, Augenbewegungsfolgung, Biometrie, Gehirnbildgebung, Bewegungsefassung und andere Technologien, um mehrkanale Interaktionsmethoden wie Augenkontrollinteraktion, Gesteninteraktion, Sprachinteraktion, Gehirn-Computer-Interaktion, emotionale Interaktion usw. in die Messaufgaben und -prozesse zu integrieren.

Das Labor basiert auf der ErgoLAB-Cloud-Plattform für die Synchronisierung der menschlichen und maschinellen Umgebung, nutzt die unabhängige Forschung und Entwicklung der Technologie von Zunda Technologie, verfügt über mehrere nationale Erfindungs- und Softwareurheberrechte, hat die Zertifizierung neuer Technologien auf der Provinzebene, die Zertifizierung neuer Produkte auf der Provinzebene, die Zertifizierung neuer Technologien auf der Provinzebene, die Zertifizierung neuer Technologien auf der Provinzebene, die Zertifizierung neuer Technologien auf der Provinzeben Das Labor kombiniert eine Vielzahl von Technologien wie ErgoLAB-Synchronisation, Cloud-Architektur, Bluetooth-Übertragung, Biometrie, Virtual Reality und Simulation, Augenbewegungsmessung, Gehirnbildgebung sowie mehrere Spitzenalgorithmen wie Multi-Sensor-Fusion und maschinelles Lernen, um wissenschaftliche Methoden zur Untersuchung der Mensch-Computer-Interaktion von Geräten und zur Datenanalyse bereitzustellen.

II. Laborbausprogramm

1. Laborlayout

Das ErgoHCI-Gehirn-Computer-Intelligenzgerät ist in eine Hauptkontrollraum und mehrere Testräume unterteilt. Der Hauptraum ist mit der ErgoLAB-Plattform für mehrdimensionale Datenanalyse und künstliche Intelligenz ausgestattet. Der Testraum ist je nach den Anforderungen der Testumgebung in Verhaltensbeobachtungs-Testraum, Virtual-Reality-Testraum, Fahrsimulationstestraum und Umweltsimulationstestraum unterteilt und verfügt über die ErgoHCI Multi-Channel-Plattform für Mensch-Computer-Interaktion und die ErgoLAB-Plattform für mehrdimensionale synchrone Datenerfassung.

2. Systemzusammensetzung

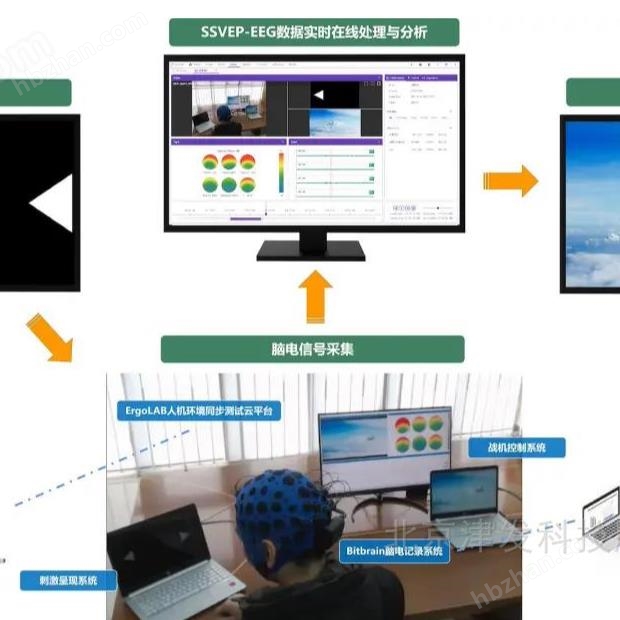

ErgoHCI Smart Equipment Multi-Channel-Mensch-Computer-Interaktion-TestlaborEs besteht aus dem ErgoHCI Multi-Channel Intelligent Human-Computer Interaction System und dem ErgoLAB Human-Computer Interaction Assessment System. ErgoHCI Multi-Channel Intelligent Human-Computer Interaction System kann die Multi-Channel-Mensch-Computer-Interaktion in die Testaufgaben und Testprozesse des Produkts integrieren, einschließlich neuer Arten von Sprache, Augensteuerung, Gesten, Gehirn-Computer, Emotionen und anderen Interaktionen sowie herkömmlicher Tasten, Mausen, Touchscreens und Griffe, um die Steuerung von Produkten und Prototypen durch die Multi-Channel-Mensch-Computer-Interaktion zu erreichen.

ErgoLAB kann mehrdimensionale objektive Daten des Bedieners während der Interaktion mit intelligenten Geräten synchron erfassen, einschließlich Augenbewegungen, Physiologie, Elektro-Gehirn, Gehirnbildgebung, Verhalten, Interaktion, Bewegungsgesten, Umweltdaten usw. und die Signalverarbeitung und statistische Analyse durchführen, um die Messung der Mensch-Computer-Interaktion durch objektive Datenindikatoren abzuschließen.

3. Labor-Funktionsanwendungen

Integration und Bewertung mehrkanaler Mensch-Computer-Interaktion

Mit der Entwicklung von Technologien wie künstlicher Intelligenz, Big Data und Emotional Computing entwickelt sich die Mensch-Computer-Interaktion auch in eine natürlicher und effizientere Richtung. Derzeit fehlt auch eine systematische Bewertung der Verfügbarkeit mehrkanaler Mensch-Computer-Interaktion. Das Labor kann intelligente Multi-Channel-Interaktionen in Produktbedienungsaufgaben und Testprozesse integrieren, wie z. B. Klicken, Schalten, Ein- und Ausschalten, Drehen, etc. durch Augensteuerung, Gesten, Sprache, Gehirn-Computer-Interaktionen, sowie die wissenschaftliche Prüfung und Validierung von Multi-Channel-Mensch-Computer-Interaktionen in Kombination mit dem ErgoLAB-Mensch-Computer-Interaktions-Messsystem.

Mensch-Maschine-Interaktion basierend auf Produktprototypen

Das Labor verwendet unabhängige Forschungs- und Entwicklungstechnologie, die direkt mit Produktdesign-Prototypen verbunden ist, einschließlich Web-Prototypen, mobilen Terminal-Prototypen, VR-Prototypen, HMI-Prototypen und so weiter. Auf der Grundlage von Prototypen für die Erfassung und Analyse von Mensch-Computer-Interaktion werden die Messergebnisse schnell in das Design zurückgegeben und die Iterationsoptimierung des Produktdesigns erreicht.

Interaktive Datenerfassung und quantitative Analyse

Das System kann alle Interaktionsdaten des Bedieners und der Ausrüstung erfassen, wie z. B. Fingerklick, Rutschen, Sprache, Gesten, Gehirn-Maschine-Ereignisse, Augenkontrolle-Interaktionen usw., und kombiniert mehrdimensionale Daten wie Augenbewegungen, Physiologie, Gehirn-Elektronik mit quantitativer Analyse, um die mehrkanale Mensch-Computer-Interaktion aus verschiedenen Phasen der Wahrnehmung, Entscheidungsfindung und Verhalten zu bewerten.

4. Kombination der Beobachtungsmethode

ErgoLAB ist kompatibel mit herkömmlichen subjektiven Bewertungsmethoden wie der Fragebogen-Skala und bietet ein umfassendes System von Datenindikatoren, indem es die subjektiven Bewertungsergebnisse mit objektiven Daten wie Augenbewegungen, Physiologie, Elektro-Gehirn, Verhalten, Interaktion und Bewegungsgeste synchronisiert.

5, Mensch-Computer-Umgebung Multimodal Datensammlung synchron

Das Labor kann mehrdimensionale Mensch-, Maschinen- und Umweltdaten synchron in Echtzeit erfassen und visualisieren, um den Mechanismus der Mensch-Maschine-Umwelt-Wechselwirkungen und ihre inneren Ursache-Folge-Beziehungen objektiv quantitativ zu analysieren.

Wissenschaftliche Unterstützung und gemeinsame Experimente

Abhängig vom Laborbau kann ZUNDA Technologie wissenschaftliche Unterstützung und gemeinsame experimentelle Dienstleistungen anbieten, die darauf abzielen, neue Technologien und Methoden mit der Verfügbarkeitstestforschung zu kombinieren, um die Erzeugung und Umsetzung von Ergebnissen in diesem Bereich zu fördern; In Kombination mit dem Modell der Industrie-Forschung-Zusammenarbeit fördern wir die Inkubation neuer Produkte für neue Technologien in Industrien, Bereichen und Berufen. Im Bereich der Mensch-Computer-Interaktion und der Verfügbarkeitstests hat Zunda Technologie mit mehreren Universitäten und Unternehmensbenutzern im ganzen Land zusammengearbeitet, um wissenschaftliche Unterstützung oder gemeinsame Experimente durchzuführen und mehr als Dutzende von Artikeln in englischer Sprache zu veröffentlichen.